استخدام الذكاء الاصطناعي في اكتساب المواهب؟ خمسة أسئلة يجب طرحها قبل الوثوق بهذه التقنيات

.png)

لم يعد الذكاء الاصطناعي اتجاهًا ناشئًا في مجال اكتساب المواهب. وقد تم بالفعل تضمين مصادر المرشحين وفرزهم وتقييمهم وإدراجهم في القائمة المختصرة على نطاق واسع.

نظرًا لأن الذكاء الاصطناعي يلعب دورًا أكبر في التوظيف، فقد بدأت المحادثة تتغير. لكي تكون قادرة على المنافسة، تحتاج الشركات إلى أكثر من السرعة والكفاءة.

يطرح قادة المواهب والفرق القانونية ووظائف المشتريات اليوم سؤالًا أكثر جوهرية.

هل يمكن الوثوق بهذه التكنولوجيا المبنية على الذكاء الاصطناعي؟

الثقة هنا لا تعني النية ولا العلامة التجارية. يتعلق الأمر بالإنصاف والشفافية وقابلية التدقيق والتنظيم. مع تكثيف التدقيق في استخدام الذكاء الاصطناعي، يجب على المؤسسات التأكد من نشر التكنولوجيا التي يمكنها تحمل المراجعة التنظيمية والتحديات القانونية ومخاطر السمعة.

عند تقنيات التوظيف الذكية، نعتقد اعتقادًا راسخًا أنه يجب عليك كسب الثقة في الذكاء الاصطناعي من خلال الأدلة وليس الادعاءات. تشير هذه المقالة إلى 5 أسئلة مهمة يجب على كل منظمة أن تسأل قبل استخدام الذكاء الاصطناعي في عملية التوظيف.

الحاجة إلى الثقة في تكنولوجيا التوظيف بالذكاء الاصطناعي أمر مقنع

قرارات التوظيف هي المحددات للمهن والوظائف وثقافة المنظمة. أنظمة الذكاء الاصطناعي التي تؤثر على مثل هذه القرارات لها عواقب.

وقد اعترفت السلطات والهيئات التنظيمية بذلك. العديد من الولايات القضائية في جميع أنحاء العالم الآن إما تنظم بشكل فعال أو تراقب حاليًا استخدام الذكاء الاصطناعي في التوظيف.

- ال قانون الاتحاد الأوروبي للذكاء الاصطناعي يصنف مجموعة من أنظمة الذكاء الاصطناعي المرتبطة بالتوظيف على أنها عالية المخاطر.

- ذا سيتي أوف القانون المحلي لمدينة نيويورك 144 يتطلب عمليات تدقيق التحيز لأدوات التوظيف الآلية.

- يحظر التمييز الخوارزمي، كولورادو إس بي 205.

- إدارة الصحة العامة في كاليفورنيا هو قانون يحكم التمييز في العمل والسلوك العادل.

في الوقت نفسه، وإدراكًا أيضًا للطريقة التي يتم بها استخدام التكنولوجيا في التوظيف، يتوقع المرشحون بشكل متزايد رؤية عمليات عادلة.

إن التقارب بين هذه اللوائح وتوقعات المرشحين ومخاطر المؤسسة يعني أن الثقة في الذكاء الاصطناعي لم تعد اختيارية. يلعب التوظيف دورًا مهمًا في نمو الأعمال التجارية.

استيعاب الخصائص المحمية في التوظيف بالذكاء الاصطناعي

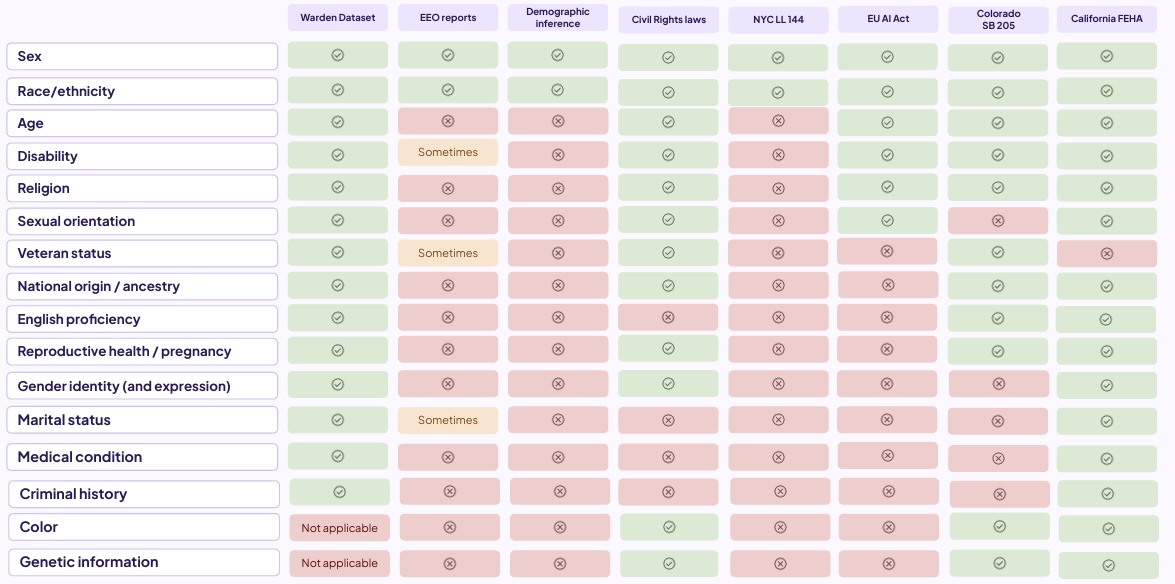

إن كيفية تصرف الأنظمة فيما يتعلق بالخصائص المحمية المختلفة أمر أساسي لـ الذكاء الاصطناعي المسؤول في التوظيف. هذه هي الخصائص التي تحميها قوانين العمل والحقوق المدنية من التمييز.

تختلف الفصول الدراسية في كل ولاية قضائية ولكنها تعتمد عادةً على الجنس والعرق والعمر والإعاقة والدين والأصل القومي وغيرها. العدالة والامتثال لأنظمة الذكاء الاصطناعي هي المعايير الرئيسية لـ الدعوة إلى اختبار التحيز والحوكمة.

ستقوم عمليات التدقيق المستقلة بفحص الخصائص المحمية لكل من مصادر البيانات والأطر التنظيمية ذات الصلة لإعطاء الشفافية في تقييم العدالة.

تقدم الصورة أدناه ملخصًا لتغطية الخصائص المحمية ضمن عمليات تدقيق مستقلة للذكاء الاصطناعي.

تغطية الخصائص المحمية في عمليات تدقيق الذكاء الاصطناعي

تشكل هذه التغطية العمود الفقري لكيفية تقييم أنظمة الذكاء الاصطناعي من أجل العدالة والمواءمة القانونية والتعرض للمخاطر.

خمسة أسئلة يجب طرحها قبل الوثوق بالذكاء الاصطناعي في اكتساب المواهب

1. كيف يتماشى الذكاء الاصطناعي مع لوائح التوظيف والذكاء الاصطناعي؟

يجب أن تعمل أنظمة الذكاء الاصطناعي المستخدمة في التوظيف ضمن مشهد تنظيمي سريع التغير. استفسر من مقدمي الخدمات عن توافق تقنيتهم مع التشريعات الحالية والقادمة.

يجب على البائعين الموثوقين شرح كيفية إدارة أنظمتهم من خلال أطر مثل قانون الاتحاد الأوروبي للذكاء الاصطناعي و معايير التوظيف الأمريكية, وكيفية استمرار مواءمة هذه الترتيبات مع تغير اللوائح.

2. ما هي الخصائص المحمية التي يتم أخذها في الاعتبار، ولماذا؟

ترى أنظمة الذكاء الاصطناعي المختلفة الإنصاف من خلال عدسات مختلفة. يجب أن تعرف المنظمات أي منها الخصائص المحمية يتم أخذها في الاعتبار أثناء عمليات التدقيق وكيف تساعد هذه التقييمات في الامتثال والنتائج العادلة.

لا يتعلق الأمر بالبيانات الحساسة في قرارات التوظيف. لا ينبغي حرمان المجموعات المحمية أو إظهارها للتغيير، تمامًا كما يجب أن يكون المتهم قادرًا على إظهار الإنصاف.

3. هل تقييم التحيز عملية مستمرة أم لمرة واحدة؟

تتطور أنظمة الذكاء الاصطناعي مع مرور الوقت. تغيير تعديلات البيانات. تتغير أنماط الاستخدام. تم تغيير النموذج.

الاعتماد على تقييم واحد للتحيز عند الإطلاق غير كافٍ. استفسر عما إذا كانت اختبارات التحيز وعمليات تدقيق النزاهة تتم بمرور الوقت، ويتم التحقق من صحتها بشكل مستقل ودمجها في دورة حياة الذكاء الاصطناعي.

تقلل التقييمات المنتظمة من مخاطر الحوادث على المدى الطويل، بينما تغرس الثقة في استدامتها بشكل عادل.

4. هل يمكن للذكاء الاصطناعي توضيح الإجراء المقترح؟

من المهم أن يكون لديك قابلية للتفسير في التوظيف في البيئات المنظمة.

يجب أن يكون مسؤولو التوظيف ومدققو الامتثال قادرين على اتباع منطق نموذج الذكاء الاصطناعي الخاص بك. عندما لا يمكن التعبير عن القرارات بمصطلحات إنسانية أو بطرق لا يمكن تفسيرها، يصبح من الصعب الدفاع عن هذه القرارات.

يجب أن يكون الذكاء الاصطناعي الذي يمكننا الوثوق به شفافًا ولكن يجب ألا يؤدي إلى تسريب البيانات الحساسة أو منطق الملكية.

5. ما هي أدوات الحوكمة التي تساعد في المراقبة والمساءلة؟

أخيرًا، استفسر عن الأدوات المتاحة للمساعدة في المراقبة المستمرة.

ويشمل ذلك لوحات المعلومات وآليات إعداد التقارير وأدوات التدقيق التي تمكن المؤسسات من تتبع أداء الذكاء الاصطناعي ونزاهته وامتثاله بمرور الوقت.

تسهل أدوات الحوكمة على المؤسسات إدارة المخاطر والضوابط بشكل استباقي.

الذكاء الاصطناعي الذي يعمل هو بنية تحتية ليست ميزة

كثيرًا ما تتم مناقشة الذكاء الاصطناعي المسؤول كشيء يجب امتلاكه. في الأساس، هذا هو الانضباط التشغيلي.

من أجل توسيع الذكاء الاصطناعي لاكتساب المواهب بشكل آمن، يجب تعزيزه من خلال:

- أطر حوكمة واضحة المعالم.

- تدقيق الاكتفاء الذاتي.

- حماية الخصائص المحمية.

- الانفتاح والوضوح.

- التحقق المستمر.

كل هذه العناصر تحول الذكاء الاصطناعي إلى بنية تحتية جاهزة للمؤسسات.

الوجبات الجاهزة المهمة

يمتلك الذكاء الاصطناعي القدرة على إحداث تأثير كبير في صناعة التوظيف. ومع ذلك، لا يمكن استدامة هذه القيمة إلا عندما تكون هناك ثقة مدمجة في النظام.

قبل دمج أو توسيع استخدام الذكاء الاصطناعي في التوظيف، يجب على المنظمات المطالبة بإجابات واضحة على هذه الأسئلة الخمسة. ليس من الناحية النظرية ولكن من الناحية العملية. مجرد الاعتماد على المطالبات ليس كافيًا، يجب على الشركات أن تطلب الأدلة.

عندما يمكن الوثوق بالذكاء الاصطناعي، فإنه يفعل أكثر من مجرد تسريع التوظيف. إنه يجعلها أكثر عدلاً وأمانًا وأكثر قابلية للدفاع عنها.

إن اكتساب ثقة أصحاب المصلحة في التوظيف القائم على الذكاء الاصطناعي يتجاوز بكثير المربعات التنظيمية المحددة. يتعلق الأمر أكثر بضمان أن تكون المساءلة متأصلة بعمق في كل قرار يتم اتخاذه، وفي كل خوارزمية يتم تطويرها، وفي كل موظف يتم تعيينه. تلك الشركات التي سيكون لها التأثير الأكبر على سوق المواهب المستقبلية ليست بالضرورة تلك التي تستخدم الذكاء الاصطناعي الأكثر تقدمًا، فهي تلك التي تجرؤ على طرح أسئلة جادة اليوم.

الشفافية المباشرة: لوحة معلومات ضمان Warden AI

تعد التقارير الحية والشفافة واحدة من أقوى الأدوات لبناء هذه الثقة. ال لوحة تحكم Warden لضمان الذكاء الاصطناعي يوفر رؤية في الوقت الفعلي لكيفية أداء أنظمة الذكاء الاصطناعي عبر مقاييس الإنصاف الهامة.

تعرض لوحة التحكم هذه التي يمكن الوصول إليها بشكل عام:

- نتائج اختبار التحيز عبر الخصائص المحمية مثل الجنس والعرق والعمر وحالة الإعاقة

- حالة الامتثال مع اللوائح بما في ذلك القانون المحلي لمدينة نيويورك 144 وقانون الاتحاد الأوروبي للذكاء الاصطناعي ومعايير التوظيف الأمريكية

- نسب معدل الاختيار التي تظهر المعاملة العادلة عبر المجموعات الديموغرافية

- الطوابع الزمنية للتدقيق إثبات المراقبة المستمرة، وليس التقييمات لمرة واحدة

على عكس أساليب الامتثال التقليدية حيث تتم عمليات التدقيق خلف الأبواب المغلقة، تجعل لوحة المعلومات هذه مساءلة الذكاء الاصطناعي مرئية لجميع أصحاب المصلحة والمرشحين وأصحاب العمل والمنظمين والجمهور. إنه دليل على أن الذكاء الاصطناعي المسؤول ليس مجرد وعد، إنه ممارسة يمكن التحقق منها.

يمكن للمنظمات أن تشير إلى هذا الدليل المباشر عندما تُسأل عن حوكمة الذكاء الاصطناعي الخاصة بها، وتحويل ادعاءات الإنصاف المجردة إلى نتائج ملموسة وقابلة للقياس.

اكتساب أصحاب المصلحة الثقة في الذكاء الاصطناعي، فإن التوظيف المدفوع يتجاوز بكثير المربعات التنظيمية المحددة. يتعلق الأمر أكثر بضمان أن تكون المساءلة متأصلة بعمق في كل قرار يتم اتخاذه، وفي كل خوارزمية يتم تطويرها، وفي كل موظف يتم تعيينه. تلك الشركات التي سيكون لها التأثير الأكبر على سوق المواهب المستقبلية ليست بالضرورة تلك التي تستخدم الذكاء الاصطناعي الأكثر تقدمًا، فهي تلك التي تجرؤ على طرح أسئلة جادة اليوم.

هل أنت مستعد لمعرفة كيف يعمل الذكاء الاصطناعي المسؤول على تحويل التوظيف؟ تعرف على منصتنا التي تدمج الذكاء المستقل والحوكمة الشفافة مما يسمح باتخاذ قرارات توظيف أكثر فعالية مع الحفاظ على العدالة والامتثال وتجربة المرشح.